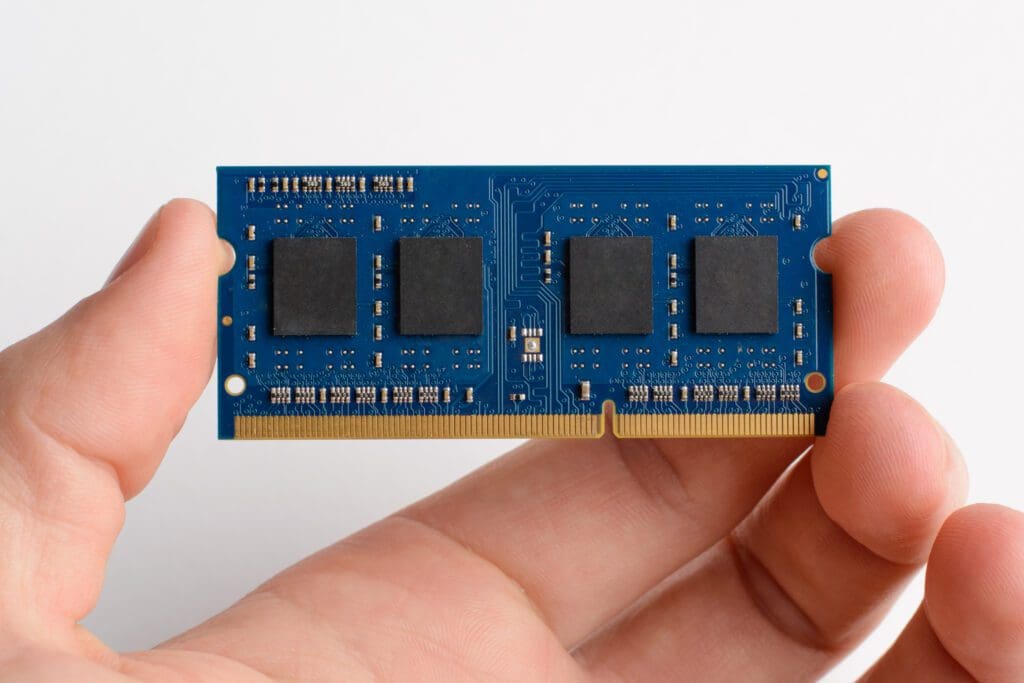

Als Buffer wird im Bereich der Informatik ein Speicher, der zur Zwischenlagerung von Daten genutzt wird, bezeichnet. Abhängig von der jeweiligen Aufgabe variiert die Struktur dieses Speichers, der im Deutschen häufig auch Puffer genannt wird. Normalerweise werden die Daten zeitweise gespeichert. Der Buffer kann sich sowohl in einem flüchtigen, als auch in einem nicht flüchtigen Speicher befinden. Ein typischer flüchtiger Speicher ist zum Beispiel der Arbeitsspeicher, zu den nicht flüchtigen zählen unter anderem Festplatten.

Als Buffer wird im Bereich der Informatik ein Speicher, der zur Zwischenlagerung von Daten genutzt wird, bezeichnet. Abhängig von der jeweiligen Aufgabe variiert die Struktur dieses Speichers, der im Deutschen häufig auch Puffer genannt wird. Normalerweise werden die Daten zeitweise gespeichert. Der Buffer kann sich sowohl in einem flüchtigen, als auch in einem nicht flüchtigen Speicher befinden. Ein typischer flüchtiger Speicher ist zum Beispiel der Arbeitsspeicher, zu den nicht flüchtigen zählen unter anderem Festplatten.

Buffer können sowohl hardware– als auch softwareseitig realisiert werden, wobei meist die softwareseitige Variante bevorzugt wird. Um den unterschiedlichen Anforderungen an die Bufferspeicherung gerecht zu werden, gibt es verschiedene Formen.

Wir analysieren Defekte an allen gängigen Datenträgern aller Hersteller - kostenlos und unverbindlich.

Sie erhalten anschließend ein Festpreis-Angebot für die Wiederherstellung Ihrer Daten. Kosten fallen nur an, wenn Sie uns beauftragen und wir Ihre Daten retten können!

100% kostenlose Analyse anfordern!FIFO-Buffer

Die FIFO-Buffer arbeiten nach dem „First In – First Out“-Prinzip. So kann ein Stau bei der Verarbeitung von Daten verwaltet werden. Diese Form ist auch als „Piping und Queueing“ bekannt, da sozusagen eine Warteschlange aus zu verarbeitenden Daten gebildet wird.

Ein Anwendungsbeispiel ist die Druckwarteschlange.

LIFO-Buffer

LIFO steht für „Last In – First Out“, dieses Prinzip ermöglicht es dem Programm nach einer Unterbrechung genau an der Stelle wieder einzusteigen, an der unterbrochen wurde. Diese Technik wird auf der Ebene der Maschinensprache realisiert und ist eine der ersten Speichersysteme in der Computertechnik gewesen. LIFO wird auch als Stapelspeicher oder Stacking bezeichnet. Problematischerweise hat der Stack eine feste Größe, die zum Pufferüberlauf führt, wenn das Zuviel an Daten nicht abgefangen wird. Dies nutzen zahlreiche Schadprogramme als Angriffspunkt.

Caching und Mapping

Um auf einem grundlegend eher langsamen Speichermedium einen schnelleren Zugriff auf Daten zu bekommen, wird ein sogenannter Cache genutzt. Bei hardwareseitiger Realisierung wird hier vom Mapping gesprochen. Diese Bufferform bildet einen Datenbereich in einem Speicher ab. Wenn die Daten eingelesen werden, erfolgt eine zusätzliche Speicherung im Cache, in dem die Daten direkt über ihre Adresse zugänglich sind. Die Adressierung des Speichermediums wird im Cache nachgebildet, wodurch ein sogenannter indirekter Zugriff ermöglicht wird. Das bedeutet, dass Schreibzugriffe während des laufenden Betriebes lediglich auf das Abbild erfolgen.

Werden die Daten sequenziell gelesen, verhält sich der Cache wie ein FIFO-Buffer. Der Vorteil eines parallelen Verfahrens ist, dass Befüllung der einen Seite des gemappten Bereiches unabhängig davon ist, wie die Daten ausgelesen werden sollen. Bei Schreibvorgängen auf Festplatten beispielsweise wird Mapping genutzt.

Swapping und Paging

Um Datensätze, die zurzeit nicht benutzt werden, aus einem schnellen Speichermedium in ein langsameres auszulagern, wird virtueller Speicher genutzt. Das hat den Vorteil, dass der schnellere, teurere Speicher kleiner dimensioniert werden kann. Der virtuelle Speicher täuscht einen wesentlich größeren aktiven Speicher vor. Beim Paging wird ein Speicherblock, beim Swapping ein komplett inaktiver Prozess ausgelagert. Die Auslagerungsdatei ist ein typisches Beispiel für einen Pagebuffer.

Heaping

Speicherbereiche, welche von Programmen mit Daten gefüllt werden, die für die spätere Bearbeitung benötigt werden, sind als dynamischer Speicher oder auch Heap bekannt. Diese Speicherreservierungen gehen über den eigentlichen Programmcode hinaus und werden üblicherweise vom Betriebssystem auf Anforderung des reservierenden Programmes bedient.

Clipboarding

Das Clipboarding umfasst Buffer, die eine fixe Anzahl von Plätzen bereitstellen. Diese können unabhängig voneinander belegt und auch gelesen werden. Die betriebssysteminterne Zwischenablage, die normalerweise nur den letzten Datensatz vorhält, ist ein solcher Kleinspeicherbereich.

Häufige Fragen und Antworten

Was ist ein Buffer?

Ein Buffer ist ein Speicher, der zur Zwischenlagerung von Daten genutzt wird. Je nach Aufgabe kann die Struktur des Buffers variieren, und er kann sich sowohl in einem flüchtigen als auch in einem nicht flüchtigen Speicher befinden. Buffers können hardware- oder softwareseitig realisiert werden und dienen dazu, die unterschiedlichen Anforderungen an die Bufferspeicherung zu erfüllen.

Welche Arten von Buffern gibt es?

Es gibt verschiedene Arten von Buffern, darunter:

- FIFO-Buffer: Arbeiten nach dem „First In – First Out“-Prinzip und verwalten einen Datenstau.

- LIFO-Buffer: Arbeiten nach dem „Last In – First Out“-Prinzip und ermöglichen den Wiedereinstieg in ein Programm an der Stelle, an der es unterbrochen wurde.

- Caching und Mapping: Nutzen einen Cache, um einen schnelleren Zugriff auf Daten zu ermöglichen.

- Swapping und Paging: Nutzen virtuellen Speicher, um Datensätze aus einem schnelleren in einen langsameren Speicher auszulagern.

- Heaping: Bezeichnen Speicherbereiche, die dynamisch mit Daten gefüllt werden und über den Programmcode hinausgehen.

- Clipboarding: Sind Buffer mit einer fixen Anzahl von Plätzen, die unabhängig voneinander belegt und gelesen werden können.

Wo werden Buffers verwendet?

Buffers werden in verschiedenen Bereichen der Informatik verwendet, darunter:

- Datenverarbeitung und -übertragung

- Dateisysteme

- Netzwerkprotokolle

- Bild- und Videobearbeitung

- Audio-Streaming

- Datenbanken